Essere prosocial. L’umanità dell’Intelligenza Artificiale

Testo a cura di Antonella Tagliabue, UN-GURU

SNARF! Sembra un'onomatopea - tipo uno sgranocchiare affrettato - ma è molto di più.

SNARF è il termine coniato da Jonah Peretti, CEO di BuzzFeed, per descrivere il tipo di contenuti che gli algoritmi dei social media tendono a favorire, ottimizzati per massimizzare l'engagement degli utenti.

SNARF è un acronimo che sta per:

- Stakes (Posta in gioco) - esagerare l'importanza o l'urgenza di un contenuto per renderlo più coinvolgente;

- Novelty (Novità) - presentare le informazioni come uniche o senza precedenti per attirare l'attenzione;

- Anger (Rabbia) - suscitare indignazione o rabbia per aumentare l'interazione;

- Retention (Ritenzione) - strutturare i contenuti in modo da mantenere gli utenti impegnati il più a lungo possibile, ad esempio attraverso titoli accattivanti o suspense;

- Fear (Paura) - evocare timori o ansie per stimolare l'attenzione e l'engagement.

Secondo Peretti, queste tattiche portano a una proliferazione di contenuti che manipolano le emozioni degli utenti, creando un ambiente digitale tossico. In pratica, SNARF è il contenuto che ti inghiotte mentre tu pensi di divorarlo. Un suono che suggerisce qualcosa di vorace, rapido e incontrollato, che rispecchia bene il comportamento degli utenti sui social media quando interagiscono con contenuti progettati per stimolare emozioni forti (rabbia, paura, curiosità…).

Ma esiste un’alternativa? Per qualcuno la risposta potrebbe essere rappresentata dai cosiddetti prosocial media

Il termine non identifica solo nuove piatteforme, ma vuole ridefinire il modo in cui le piattaforme social vengono progettate e utilizzate, per promuovere benessere sociale e coesione della comunità oltre l’engagement.

La definizione è stata elaborata in un paper accademico pubblicato nel febbraio 2025 da Divya Siddarth, Audrey Tang e Glen Weyl, dal titolo “Prosocial Media”. Il paper analizza i grandi modelli linguistici (LLM) - come GPT-4, Claude o PaLM - chiedendosi se siano in grado di rispondere a domande morali o sociali, a essere altruisti, giusti o empatici, in pratica a fare “la cosa giusta”, e se scelgano la cooperazione rispetto all’egoismo.

Il metodo di analisi si basa su scenari di scelta morale e giochi economici, presi dalla psicologia e dall’economia comportamentale, tipo “preferisci dieci euro per te o otto euro per te e anche qualcun altro”. Modelli per misurare se il modello pensa in modo prosociale, come farebbe una persona empatica.

Il risultato è che i modelli più avanzati (come GPT-4 e Claude) sono sistematicamente prosociali: non solo danno risposte “etiche”, ma lo fanno in modo coerente, in diversi scenari e formulazioni.

I modelli che sono stati addestrati usando il feedback umano (RLHF: Reinforcement Learning from Human Feedback) sono molto più prosociali di quelli non allineati. In pratica, se gli umani dicono a un modello “questa è una buona risposta”, il modello impara non solo il contenuto, ma anche il valore morale.

I modelli open-source come LLaMA (senza RLHF o con meno rifinitura etica) tendono a esserlo meno e non mostrano la stessa costanza nei comportamenti prosociali.

Se un modello AI è allineato a valori umani e si comporta in modo prosociale, allora si può usare per moderare contenuti online in modo empatico, guidare conversazioni costruttive nei social media, promuovere cooperazione, rispetto, equità in ambienti digitali. Questo apre la porta a piattaforme digitali basate su AI che non solo funzionano bene, ma aiutano anche le persone a interagire in modo più umano e positivo.

Ovviamente, perché l’AI faccia bene va usata bene. Tutto dipende da come viene formulata la domanda (framing), dal contesto, dalle istruzioni date. Quindi serve controllo, studio e responsabilità.

La supervisione umana può introdurre valori e preferenze che non emergono spontaneamente dai dati web, ma non basta addestrare il modello su internet; serve un processo di allineamento mirato per ottenere comportamenti prosociali affidabili.

Lo studio dimostra anche che le risposte prosociali non sono frutto di frase fatte. I modelli più avanzati sono in grado di valutare le opzioni in termini di flessibilità, contestualizzazione e ragionamento morale e non ripetono le risposte meccanicamente.

In conclusione, il paper stabilisce che "i modelli linguistici di nuova generazione possono essere progettati per riflettere preferenze morali e prosociali. Questo non solo li rende più utili, ma anche più sicuri e socialmente responsabili."

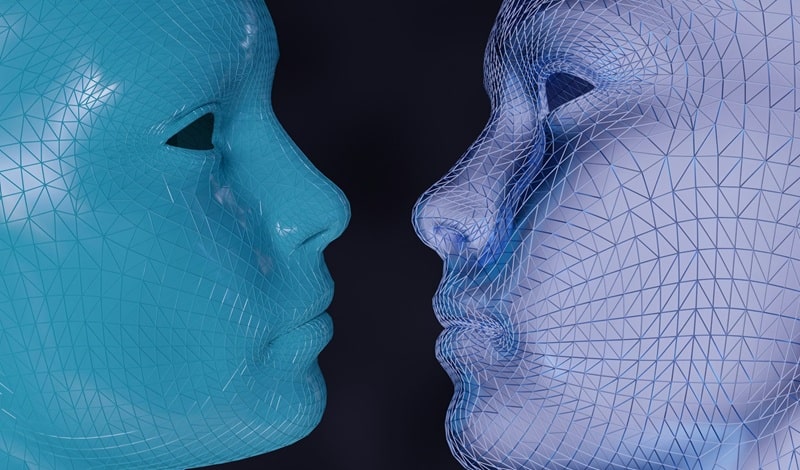

In copertina: foto di Steve Johnson su Unsplash

Resta connesso con l'innovazione sociale

Se questo contenuto ti è stato utile, iscriviti alla nostra newsletter settimanale: ogni lunedì, bandi, opportunità e progetti direttamente nella tua casella.

📧 Iscriviti alla newsletter

💼 Seguici su LinkedIn e Facebook

📱 Unisciti al canale Telegram

Tutti i contenuti di Innovazione Sociale sono accessibili gratuitamente. Chi collabora con noi sostiene un modello che dedica spazio a nuove realtà, mantiene rubriche come Bandi e finanziamenti e IMPATTI libere per tutti, e garantisce accesso universale all'informazione di qualità.

Dicono di noi...

Ultimi Articoli

- Ecosistema circolare: ambiente, solidarietà e collaborazione. Il Salone della CSR arriva a Varese 05 Maggio 2026

- Volontariato oggi: evoluzione, nuove forme e ruolo trasformativo 05 Maggio 2026

- Design Economy 2026: l’Italia guida il settore europeo tra crescita e innovazione 29 Aprile 2026

- Changemaking in Italia: la nuova mappa dell’innovazione sociale nel Paese 24 Aprile 2026

- Social Innovation Trail 2026: l’AI come infrastruttura di policy per l’innovazione sociale 24 Aprile 2026